Por Iara Lemos

Jornalista, diretora-geral da Free Minds Comunicação, delegada do Grupo de Trabalho sobre Governança da Inteligência Artificial da OCDE

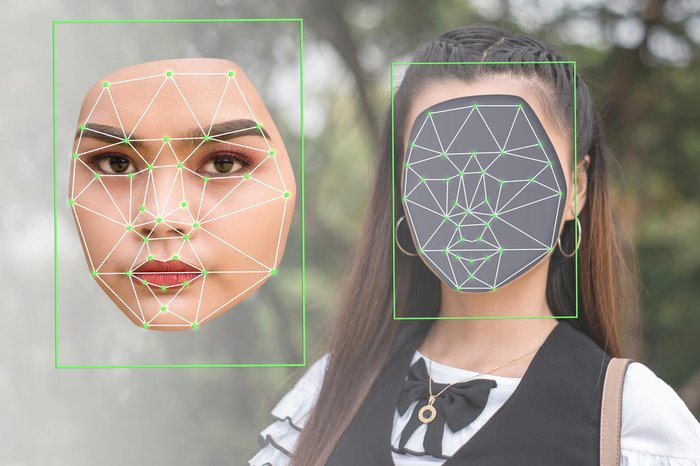

Ao longo dos últimos anos, os especialistas da inteligência artificial (AI) têm acumulado uma série de preocupações, que se tornam mais exacerbadas se levarmos em consideração que o Brasil está, mais uma vez, em um ano eleitoral. E que o Tribunal Superior Eleitoral (TSE) não tem estrutura tecnológica nem mão de obra para barrar usos distorcidos de IA nas campanhas eleitorais, especialmente os chamados deep fakes.

Quando se cruza a Praça dos Três Poderes, percebe-se que há abundante promessa por parte das lideranças políticas, mas pouco detalhamento do que será colocado em votação sobre as regras do uso de IA no país. A avaliação no Congresso Nacional é de que a regulamentação pode se transformar em um puxadinho de legislação, aos moldes da reforma eleitoral. Nesse caso, as regras são feitas aos pedaços, já que os parlamentares temem destoar do que defendem os partidos políticos, detentores de robustas verbas.

Pelo segundo ano, sou a única jornalista brasileira a participar do Grupo de Trabalho sobre Governança de Inteligência Artificial (Aigo) da Organização para a Cooperação e Desenvolvimento Econômico (OCDE). Cheguei ao colegiado após indicação do Atlantic Council (EUA), com o qual fiz um curso de especialização em IA entre 2021 e 2022. Naquele período, a Câmara dos Deputados iniciava os debates que resultaram na aprovação do Projeto de Lei 21/2020, que regulamenta o Marco da Inteligência Artificial. A proposta foi ao Senado, mas, a despeito de inúmeros debates, já se passaram dois anos sem aprovação de uma legislação sobre o tema.

Quando se fala em IA, o embaraço dos parlamentares está em enfrentar o lobby das big techs, que avançam as peças para que sejam isentas de responsabilidades pelo mau uso de IA nas campanhas eleitorais. Diante da demora do Congresso Nacional, as empresas de tecnologia se fortaleceram e devem levar à lei o que o TSE já garantiu para as eleições de 2024, cabendo ao candidato avisar aos eleitores quando for feito o uso de IA.

Enquanto isso, na OCDE, o trabalho avança para que existam demarcações legais para barrar debates por ciclos de IA. A ideia é que os países consigam incluir o conceito de cadeia de valor de IA nos princípios de suas legislações, o que é bem diferente dos chamados atores de ciclo de vida de IA, que são mais perecíveis. A mudança integra a atualização da Regulamentação em Inteligência Artificial (OECD/Legal/0449), que foi adotada em 2019 pela OCDE, e que prevê revisões a cada cinco anos.

A resolução norteia os trabalhos do colegiado internacional, assegurando em todos os níveis, simultaneamente, o respeito pelos direitos humanos e pelos valores democráticos dos países. Complementa, ainda, normas já existentes na OCDE, que dizem respeito à privacidade, à gestão dos riscos de segurança digital e à conduta empresarial responsável. Por isso, há entendimentos de que a alteração no conceito permitirá que a resolução seja suficientemente flexível para resistir ao teste do tempo neste domínio em rápida evolução.

Para que tudo isso funcione, a OCDE considera necessário um debate público bem-informado, que envolva toda a sociedade para capturar o potencial benéfico da tecnologia, limitando os riscos a ela associados. É aí que entra a necessidade de o Congresso Nacional avançar na legislação.

Somente dessa forma os sistemas de IA podem funcionar sem representarem riscos de segurança excessivos, incluindo problemas de controle não intencionais e prejudiciais à integridade da informação. Puxadinhos na legislação não podem ser aceitos em um tema tão importante quanto a inteligência artificial.